深度神经网络压缩与加速技术 赋能高效网络服务的新引擎

随着人工智能技术的快速发展,深度神经网络(DNN)在图像识别、自然语言处理、语音识别等领域取得了显著成就。日益复杂的网络模型带来了巨大的计算和存储开销,严重限制了其在资源受限环境下的部署。深度神经网络压缩与加速技术应运而生,成为推动高效网络服务落地的关键技术。

一、深度神经网络压缩技术

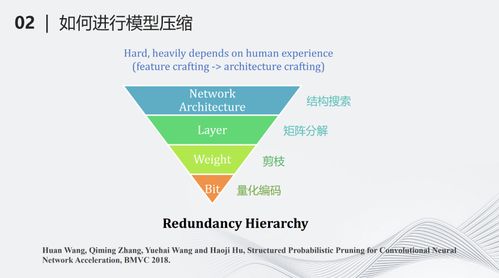

深度神经网络压缩主要通过减少模型的参数量和计算量,同时尽量保持模型的准确性。主要压缩方法包括:

- 权重剪枝:通过移除冗余或重要性较低的连接,减少网络参数。例如,迭代式剪枝可逐步识别并移除对精度影响最小的权重。

- 量化:将浮点权重和激活值转换为低精度表示,如8位整数。量化不仅能减小模型存储空间,还能加速推理过程。

- 知识蒸馏:利用预训练的大模型(教师模型)指导小模型(学生模型)训练,使小模型学习到大模型的泛化能力。

- 低秩分解:将全连接层或卷积层的权重矩阵分解为多个小矩阵的乘积,从而降低计算复杂度。

二、深度神经网络加速技术

网络加速技术侧重于优化计算过程,提升推理速度:

- 硬件加速:利用GPU、TPU、FPGA等专用硬件并行计算能力,大幅提升神经网络前向推理速度。

- 网络结构优化:设计轻量级网络结构,如MobileNet、ShuffleNet等,通过深度可分离卷积等技术减少计算量。

- 编译器优化:通过图优化、算子融合等技术,减少内存访问和计算开销,如TVM、TensorRT等推理框架。

- 动态推理:根据输入样本的复杂度动态调整计算路径,简单样本使用轻量级子网络,复杂样本使用完整网络。

三、网络服务中的应用价值

压缩与加速技术为网络服务带来显著优势:

- 边缘计算部署:使复杂神经网络能够在手机、嵌入式设备等资源受限环境中高效运行,实现本地化智能服务。

- 实时服务响应:大幅降低推理延迟,满足自动驾驶、实时翻译等对响应时间敏感的应用需求。

- 成本优化:减少服务器资源消耗,降低云计算成本,使大规模AI服务部署更加经济可行。

- 能耗降低:轻量化模型减少计算能耗,符合绿色计算发展趋势。

四、未来发展趋势

未来深度神经网络压缩与加速技术将向更智能、更自动化的方向发展:

- 自动化压缩:基于强化学习或进化算法的自动网络压缩,无需人工设计压缩策略。

- 硬件算法协同设计:针对特定硬件架构优化网络结构,实现算法与硬件的最佳匹配。

- 动态自适应压缩:根据设备状态和环境需求动态调整模型复杂度,实现资源与性能的最佳平衡。

- 跨模态压缩:面向多模态应用的统一压缩框架,支持视觉、语言、语音等多种任务的联合优化。

深度神经网络压缩与加速技术正在重塑人工智能服务的部署范式,为各行各业提供更高效、更经济的智能解决方案。随着技术的不断成熟,我们有理由相信,压缩后的轻量化神经网络将在更多场景中发挥关键作用,推动人工智能技术真正实现普惠化应用。

如若转载,请注明出处:http://www.amw-overseas2019.com/product/4.html

更新时间:2026-06-01 22:44:46